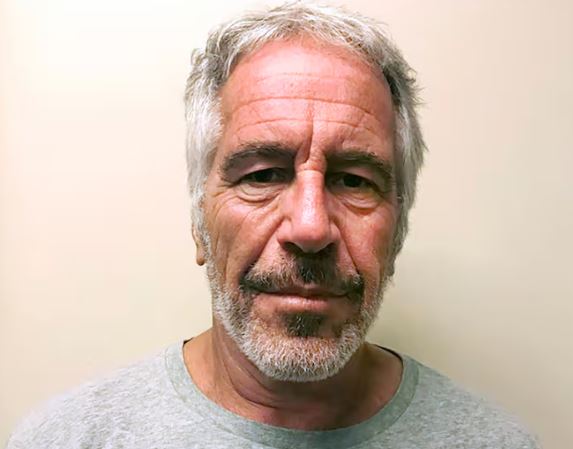

Usuarios y analistas detectaron que TikTok reduce drásticamente el alcance de contenidos con palabras sensibles como “Epstein”. El fenómeno, observado en los últimos días en redes sociales, reaviva el debate global sobre censura algorítmica, control de la conversación pública y el rol de las plataformas digitales.

Contenidos que no llegan a nadie

Cada vez con más frecuencia, publicaciones en cuentas populares registran caídas abruptas de visualizaciones sin una explicación visible. Videos y mensajes que incluyen términos específicos simplemente dejan de circular. En TikTok, la palabra “Epstein” se convirtió en un caso testigo: contenidos asociados a ese nombre no lograron rebote ni interacción, aun cuando provenían de perfiles con alto alcance.

Este tipo de bloqueo no se manifiesta como una eliminación directa, sino como una reducción casi total de la distribución, una práctica conocida como shadowban o censura algorítmica.

El poder ya no está en los usuarios

Aunque siguen denominándose “redes sociales”, estas plataformas dejaron de funcionar como espacios horizontales de intercambio. La visibilidad ya no depende de la conversación entre personas, sino de sistemas automáticos que deciden qué contenidos se amplifican y cuáles quedan relegados al silencio.

El ideal de una “plaza pública digital”, promovido años atrás por referentes tecnológicos, fue reemplazado por entornos donde la arquitectura de la plataforma concentra el poder de decisión.

Qué se ve, qué se repite y qué se oculta

Especialistas en sociología digital advierten que los algoritmos no solo distribuyen información, sino que administran la atención y las emociones. Estos sistemas definen qué temas emergen, cuáles se repiten y cuáles desaparecen sin dejar rastro.

En ese esquema, la falta de alcance no responde necesariamente a errores técnicos ni a decisiones manuales, sino a la lógica profunda de funcionamiento de las plataformas, que priorizan ciertos flujos de contenido por sobre otros.

La pérdida de “resonancia” en las plataformas

El sociólogo alemán Hartmut Rosa define como “resonancia” a la experiencia de recibir una respuesta significativa del entorno. En redes sociales, esa resonancia se traduce en vistas, comentarios o interacciones.

Cuando el algoritmo corta ese circuito, aparece el silencio. Sin respuestas, los usuarios tienden a atribuir el problema a fallas propias, aunque en muchos casos se trata de una decisión estructural del sistema que regula la visibilidad.

Casos recientes también mostraron caídas de alcance en contenidos vinculados a políticas migratorias en Estados Unidos, como publicaciones sobre operativos de la patrulla ICE, lo que refuerza la sospecha de filtros temáticos.

Acceso no siempre significa visibilidad

Incluso en plataformas percibidas como más abiertas, como LinkedIn o Bluesky, la visibilidad depende de infraestructuras que no garantizan interacción real. Tener acceso a publicar no implica necesariamente ser escuchado.

Ante este escenario, algunos analistas proponen replantear el sentido de la comunicación digital y recuperar espacios donde la conversación no esté mediada por métricas de optimización.